Para poder competir con sus rivales, Apple ha empezado a apostar más por la inteligencia artificial. Google o Facebook no tienen problemas al recoger datos de los usuarios y reconocer que lo hacen para mejorar sus sistemas de inteligencia artificial y aprendizaje automático (Machine Learning), pero Apple no piensa lo mismo; a los de Cupertino sí que les preocupa nuestra privacidad. Por esa razón, en la pasada WWDC nos hablaron de Differential Privacy, su sistema para recoger datos, mejorar su AI y, al mismo tiempo, proteger nuestra privacidad.

El resto de compañías quieren saber constantemente cosas como dónde estamos, qué compramos o cómo usamos el teclado, lo que incluye lo que buscamos, pero no parece que esto le haya preocupado nunca a Apple, una compañía que, en teoría, no tiene nada que hacer con los datos de sus clientes: no venden publicidad, sólo sus productos. Tim Cook y compañía ofrecen dispositivos seguros para que los usuarios también nos sintamos seguros, y eso es algo que Apple no quiere cambiar.

Differential Privacy estudia el general, protege al individuo

Como ya dijeron algunos especialistas en Machine Learning y AI, el problema para Apple es que, si no hace algo, se quedará años luz por detrás de la competencia en cuanto a asistentes virtuales. Aquí es donde entre en juego el Differential Privacy del que nos hablaron en la pasada WWDC. Craig Federighi lo explicaba así:

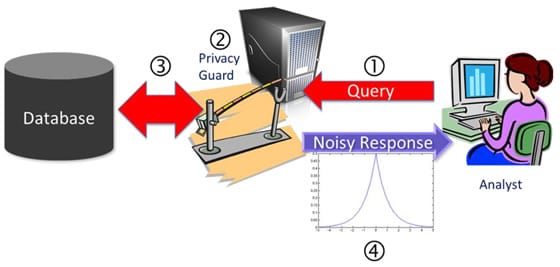

Differential Privacy es un tema de investigación en el área de estadísticas y análisis de datos que usa algoritmos hash, submuestreo e inyección de ruido para permitir este tipo de aprendizaje de muchas fuentes mientras se mantiene la información de cada usuario totalmente privada.

Differential Privacy no es un invento de Apple. Los académicos han estudiado el concepto durante años pero, con el lanzamiento de iOS 10, Apple empezará a usar este concepto para recoger y analizar datos de usuarios del teclado, Spotlight y Notas.

Differential Privacy funciona mediante la codificación de algoritmos de datos de individuos, de manera que no se pueda controlar a la persona una vez se hayan analizado los datos de miles de usuarios para recoger patrones de tendencias a gran escala. El objetivo es proteger la identidad del usuario y los detalles de sus datos al mismo tiempo que se consigue información general que ayudará a mejorar el aprendizaje automático

iOS 10 mezclará aleatoriamente nuestros datos dentro de nuestro dispositivo antes de enviárselos en masa a Apple, por lo que los datos nunca se enviarán de manera insegura. Por otra parte, Apple tampoco almacenará cada palabra que escribamos con el teclado o las búsquedas que realizamos porque, como he mencionado anteriormente, no lo necesita. Los de Cupertino dicen que limitarán la cantidad de datos que pueden recoger de cada usuario.

Apple ofreció los documentos de su implementación de Differential Privacy al profesor Aaron Roth de la Universidad de Pennsylvania y el profesor, quien se podría decir que ha escrito la Biblia sobre la privacidad diferencial (Fundaciones algorítmicas de privacidad diferencial), y describió el trabajo de Apple en este terreno como «pionero» o «innovador».

Cómo funciona Differential Privacy

Differential Privacy no es una tecnología única. Es una aproximación al procesado de datos que crea restricciones para evitar que los datos se relacionen con usuarios concretos. Permite que los datos sean analizados en conjunto, pero añade cierto ruido a los datos, lo que hace que la privacidad individual no sufra al mismo tiempo que los datos son procesados en masa. Adam Smith lo define de la siguiente manera:

Técnicamente es una definición matemática. Simplemente restringe las diferentes maneras en las que se pueden procesar los datos. Y los restringe de una manera que no permite que se vincule demasiada información sobre ningún punto de extracción de intervalo individual en el grupo de datos.

Por otra parte, compara a Differential Privacy con ser capaz de seleccionar una melodía subyacente detrás de una capa de ruido estático de una radio mal sintonizada:

Una vez entiendes lo que estás escuchando, es realmente fácil ignorar la estática. Así que es un poco como lo que pasa con cada individuo, no aprendes demasiado de un sólo individuo, pero en conjunto se pueden ver los patrones bastante claros.

Smith cree que Apple es la primera compañía importante que intenta usar Differential Privacy a gran escala. Otras compañías como AT&T han realizado estudios, pero aún no se han atrevido a usarlo.

¿Y el futuro de la Inteligencia Artificial?

El debate de la privacidad de Sillicon Valley suele verse a través de las fuerzas de la ley, que pone en una balanza la privacidad y la seguridad nacional. Para las compañías, el debate está entre la privacidad y las funciones. Lo que ha empezado Apple podría cambiar el debate radicalmente.

Google y Facebook, entre otros, han intentado resolver la cuestión de cómo ofrecer grandes productos con muchas funciones que al mismo tiempo sean privados. Ni Allo, la aplicación de mensajería más nueva de Google, ni Facebook Messenger ofrecen cifrado de extremo-a-extremo por defecto porque ambas compañías necesitan los datos de los usuarios para mejorar su aprendizaje automático y permitir que funcionen sus bots. Apple también quiere recoger datos de los usuarios, pero no por ello eliminará el cifrado de extremo-a-extremo de iMessage. Smith dice que la implementación de Apple podría hacer que el resto de compañías cambiaran su manera de pensar.

En definitiva, parece que Apple se ha atrevido a usar un sistema del que ya existían teorías que recogerá datos de mucha gente sin violar nuestra privacidad. ¿Le copiará alguien en esto?