Zdá se, že Apple se rozhodl s jeho zastavením plán CSAM revizí, které plánovala provést na fotografiích svých uživatelů hledajících dětskou pornografii. Na stránkách Applu už po kontroverzním plánu není ani stopa.

Nevíme, zda se v tuto chvíli jedná o dočasné stažení, hledání nejlepšího způsobu implementace systému nebo prostě o přerušení projektu. Faktem je, že plán CSAM zmizel ze stránky bezpečnosti dětí web oficiální Apple.

Už pár měsíců mluvíme o kontroverzním projektu, který měl Apple na mysli, na zvýšení bezpečnosti digitálního obsahu svých zařízení. To se nazývá plán CSAM Apple.

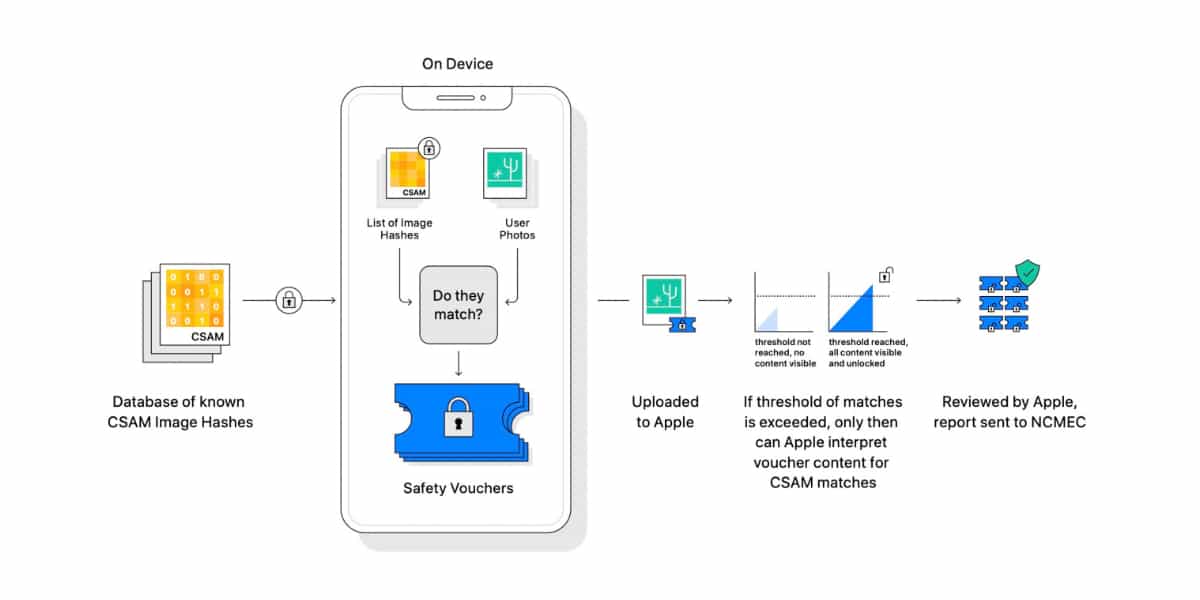

Tento plán chtěl použít kombinovaný nejprve automatický a poté manuální systém tzv neuralMatch objevovat podezřelé obrázky zneužívání dětí v soukromých knihovnách uživatelů, které je uchovávají na iCloudu.

Systém zamýšlel provést automatické digitální skenování všech fotografií, které si uživatel uloží na svůj iCloud účet. Pokud serverový software detekoval možnou „podezřelou“ fotografii obsahující dětskou pornografii, upozornil tým z lidští recenzenti aby to zkontrolovali.

Pokud zmíněný recenzent viděl na obrázku možné zneužívání dětí, Apple Sdělil bych to místním úřadům relevantní. Záměry společnosti byly zjevně dobré, ale záměry společnosti Soukromí lidí.

Krátce poté, co Apple oznámil svůj plán CSAM, čelil záplavě kritiky od skupin na ochranu soukromí, skupin na ochranu práv a organizací na ochranu soukromí. Právo na soukromí. K negativní reakci na projekt své firmy se přidaly i některé skupiny zaměstnanců společnosti.

Projekt zastaven, nezahozen

Nyní jablko vymazal z vaší stránky Bezpečnost dětí z jeho oficiálních webových stránek jakékoli náznaky projektu CSAM, jehož spuštění se plánuje v budoucí verzi iOS 15. Podle právě zveřejněného VergeApple neopustil projekt CSAM, ale chce vidět, jak jej může upravit tak, aby byl přijat všemi těmi odpůrci. Je to těžké.