Eine von Apples Obsessionen ist Sicherheit seiner Nutzer. Wir alle wissen, wie sehr sich das Unternehmen um die Privatsphäre seiner Kunden kümmert, etwas, das Apple heilig ist. Dafür muss er sich der US-Regierung stellen, sogar der CIA. „Die Daten meiner Nutzer werden nicht angerührt“ lautet ihr Motto.

Und jetzt hat es sich auf die Sicherheit seiner minderjährigen Benutzer konzentriert. Das wird reichen "Großer Bruder»Überwachen der Bilder, die seine Server passieren, sowohl beim Senden von Nachrichten als auch von in iCloud gespeicherten Fotos, um Fotos zu erkennen, die Material von sexuellem Missbrauch von Kindern enthalten. Bravo.

Diejenigen aus Cupertino haben gerade diese Woche eine Reihe von Maßnahmen angekündigt, die sie mit dem Ziel umsetzen werden, minderjährige Benutzer der iPhone, iPad y Mac. Dazu gehören neue Kommunikationssicherheitsfunktionen in Nachrichten, eine verbesserte Erkennung von Inhalten über sexuellen Missbrauch von Kindern (CSAM) in iCloud und aktualisierte Wissensinformationen für Siri und Search.

Ich meine, was meinst du? Untersuche jedes Foto der Benutzer unter 13 Jahren, die seine Server passieren, entweder beim Senden oder Empfangen von Nachrichten oder denen, die in iCloud gespeichert sind, um diejenigen zu erkennen, die kinderpornografischen Inhalten verdächtig sind. Sobald das verdächtige Bild automatisch gefunden wurde, wird gemeldet, dass es von einer Person überprüft wurde. Es wird auch Kontrollen für Suchen und Siri geben.

An Nachrichten angehängte Fotos

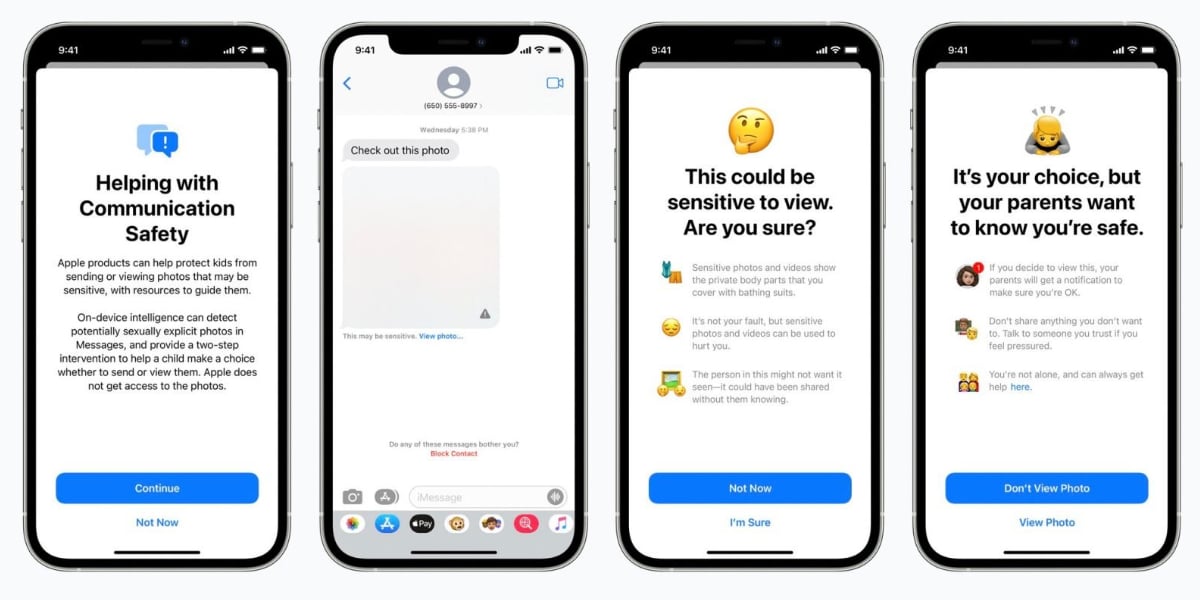

Apple erklärt, dass, wenn ein Minderjähriger in einer ICloud-Familie empfängt oder versucht, eine Nachricht mit Fotos mit sexuellem Inhalt zu senden, wird dem Kind eine Warnmeldung angezeigt. Das Bild wird unscharf und die Nachrichten-App zeigt eine Warnung an, dass das Bild „sensibel sein könnte“. Wenn das Kind "Foto anzeigen" berührt, wird eine Popup-Meldung angezeigt, die es darüber informiert, warum das Bild als sensibel eingestuft wird.

Wenn das Kind darauf besteht, das Foto anzusehen, erhält sein Vater von iCloud Family ein Benachrichtigung "Um sicherzustellen, dass die Anzeige korrekt ist." Das Popup-Fenster enthält auch einen Quicklink für zusätzliche Hilfe.

Für den Fall, dass das Kind versucht, ein als sexuell beschriebenes Bild zu senden, wird eine ähnliche Warnung angezeigt. Apple sagt, dass der Minderjährige gewarnt wird, bevor das Foto gesendet wird, und dass Eltern eine Nachricht erhalten können, wenn das Kind sich entscheidet, es zu senden. Diese Kontrolle wird in den Apple-ID-Konten durchgeführt, die zu gehören Kinder unter 13 Jahren.

Fotos in iCloud

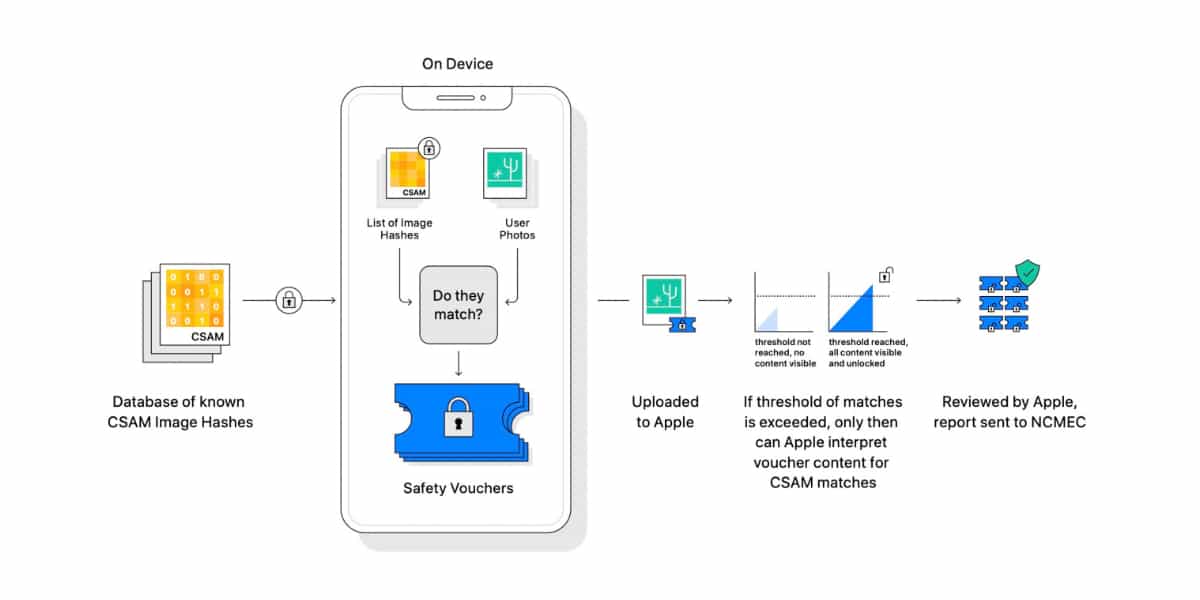

So verarbeitet Apple Fotos eines Kindes unter 13 Jahren.

Apple will CSAM-Bilder erkennen (Material zum sexuellen Missbrauch von Kindern), wenn es in iCloud-Fotos gespeichert wird. Das Unternehmen kann dann einen Hinweis an das National Center for Missing and Exploited Children melden, eine nordamerikanische Einrichtung, die als umfassende Meldestelle für CSAM fungiert und eng mit den Strafverfolgungsbehörden zusammenarbeitet.

Wenn das System ein mögliches CSAM-Image findet, meldet es es als von einer realen Person verifiziert, bevor Sie etwas unternehmen. Nach der Bestätigung wird Apple das Konto des Benutzers deaktivieren und einen Bericht an das US National Center for Missing & Exploited Children übermitteln.

Die Bilder, die auf dem Gerät gespeichert werden und nicht über die iCloud-Server laufen, können von Apple offensichtlich nicht kontrolliert werden. Dieses ganze Kinderkontrollsystem es wird zuerst in den USA implementiert., und später wird es auf andere Länder ausgeweitet, beginnend mit iOS 15, iPadOS 15 und macOS Monterey.

Suchen und Siri

Siri wird sich der Suchen bewusst sein, die ein Benutzer in Bezug auf die CSAM-Thema. Zum Beispiel werden diejenigen, die Siri fragen, wie sie CSAM oder Ausbeutung von Kindern melden können, auf die Ressourcen verwiesen, wo und wie eine Anzeige eingereicht werden kann, wodurch eine mögliche Strafverfolgung erleichtert wird.

Persönlichkeiten wie John Clark, Präsident und CEO des National Center for Missing and Exploited Children, Stefan Balkam, Gründer und CEO des Family Online Safety Institute, ehemaliger Generalstaatsanwalt Eric Holder oder der ehemalige stellvertretende Generalstaatsanwalt Georg Terwilliger Sie haben ihre volle Unterstützung für die Apple-Initiative zum Ausdruck gebracht.