Appleの強迫観念のXNUMXつは セキュリティ そのユーザーの。 私たちは皆、Appleにとって神聖な何かである顧客のプライバシーを会社がどれほど気にかけているかを知っています。 このために彼は米国政府、さらにはCIAに直面しなければなりません。 「ユーザーのデータには触れない」がモットーです。

そして今、それは未成年のユーザーの安全に焦点を合わせています。 それはします«ビッグブラザー»メッセージを送信するときとiCloudに保存されている写真の両方でサーバーを通過する画像を監視して、児童の性的虐待の内容を含む写真を検出します。 ブラボー。

クパチーノの人々は今週、未成年のユーザーを保護することを目的として実施される一連の対策を発表しました。 iPhone, iPad y Mac。 これらには、メッセージの新しい通信セキュリティ機能、iCloudでの児童性的虐待資料(CSAM)コンテンツの検出の改善、Siriと検索の更新された知識情報が含まれます。

つまり、あなたはどう思いますか 各写真を調べる 児童ポルノコンテンツの疑いのあるユーザーを検出するために、メッセージの送信または受信のいずれかでサーバーを通過する、またはiCloudに保存されている13歳未満のユーザーの割合。 疑わしい画像が自動的に特定されると、その画像は人によって確認されたと報告されます。 検索とSiriのコントロールもあります。

メッセージに添付された写真

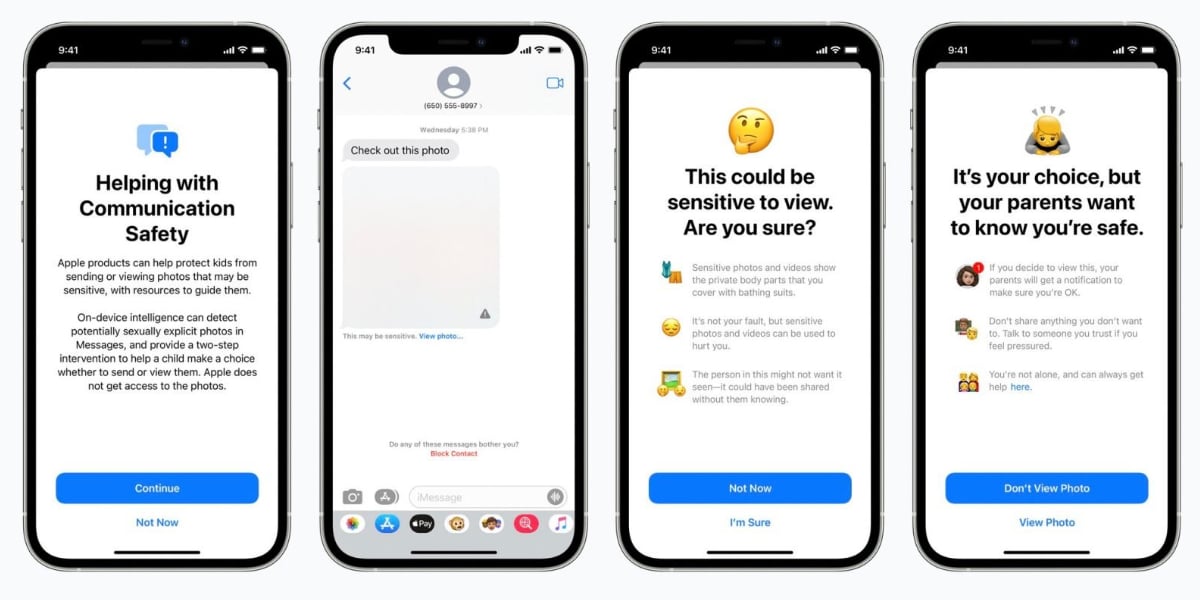

Appleは、未成年者が ICloudファミリー 性的な内容の写真を含むメッセージを受信または送信しようとすると、子供には警告メッセージが表示されます。 画像がぼやけ、メッセージアプリに「機密性が高い可能性があります」という警告が表示されます。 子供が[写真を表示]をタッチすると、画像が機密であると見なされる理由を通知するポップアップメッセージが表示されます。

子供が写真を見ることを主張する場合、iCloudファミリーの父親は 通告 「表示が正しいことを確認するため。」 ポップアップウィンドウには、追加のヘルプへのクイックリンクも含まれます。

子供が性的であると説明されている画像を送信しようとすると、同様の警告が表示されます。 Appleによれば、未成年者は写真が送信される前に警告され、子供が写真を送信することを決定した場合、親はメッセージを受信できるとのことです。 この制御は、に属するAppleIDアカウントで実行されます。 13歳未満の子供.

iCloudの写真

これは、Appleが13歳未満の子供の写真を処理する方法です。

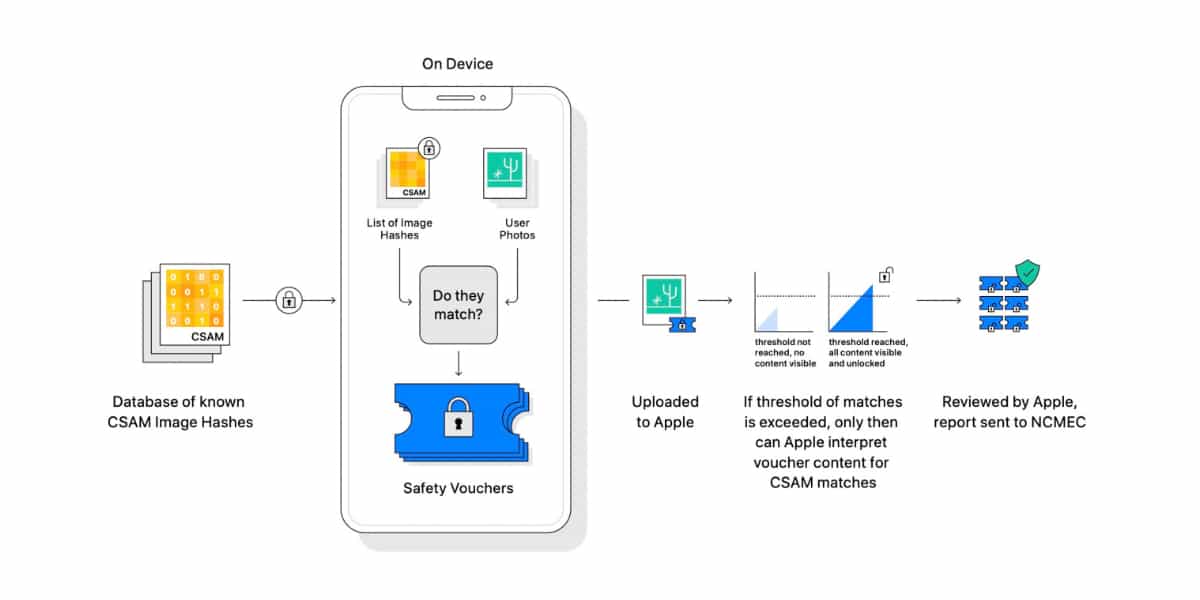

Appleは望んでいる CSAM画像を検出する (児童の性的虐待資料)iCloud写真に保存されている場合。 その後、同社は、CSAMの包括的な報告機関として機能し、法執行機関と緊密に連携している北米の組織である全米行方不明・搾取児童センターにヒントを報告できるようになります。

システムがCSAMイメージの可能性を検出すると、次のように報告します。 実在の人物による検証、アクションを実行する前に。 確認されると、Appleはユーザーのアカウントを無効にし、米国国立行方不明・搾取児童センターにレポートを提出します。

デバイスに保存され、iCloudサーバーを通過しない画像は、明らかにAppleによって制御することはできません。 この子供全体の制御システム それは最初に米国で実装されます。、そしてその後、iOS 15、iPadOS 15、macOSMontereyから他の国にも拡張される予定です。

検索とSiri

Siriは、ユーザーが CSAMテーマ。 たとえば、CSAM や児童搾取を報告する方法を Siri に尋ねた人は、報告の場所と方法に関するリソースに誘導されるため、訴追が容易になります。

のような性格 ジョン·クラーク、全米行方不明・搾取児童センターの社長兼CEO、 スティーブンバルカム、Family Online Safety Instituteの創設者兼最高経営責任者、元司法長官 エリックホルダー または元司法副長官 ジョージ・ターウィリガー 彼らはAppleイニシアチブへの全面的な支持を表明しました。