Parece que a Apple decidiu parar seu Plano CSAM das revisões que planejava implementar nas fotos de seus usuários em busca de pornografia infantil. Não há mais vestígios do polêmico plano no site da Apple.

Não sabemos se no momento se trata de uma retirada temporária, buscando a melhor forma de implantar o sistema, ou simplesmente aborta o projeto. O fato é que o plano CSAM desapareceu da página de segurança infantil do site oficial Apple.

Já faz alguns meses que falamos sobre o polêmico projeto que a Apple tinha em mente, de aumentar a segurança do conteúdo digital de seus aparelhos. É chamado Plano CSAM Apple.

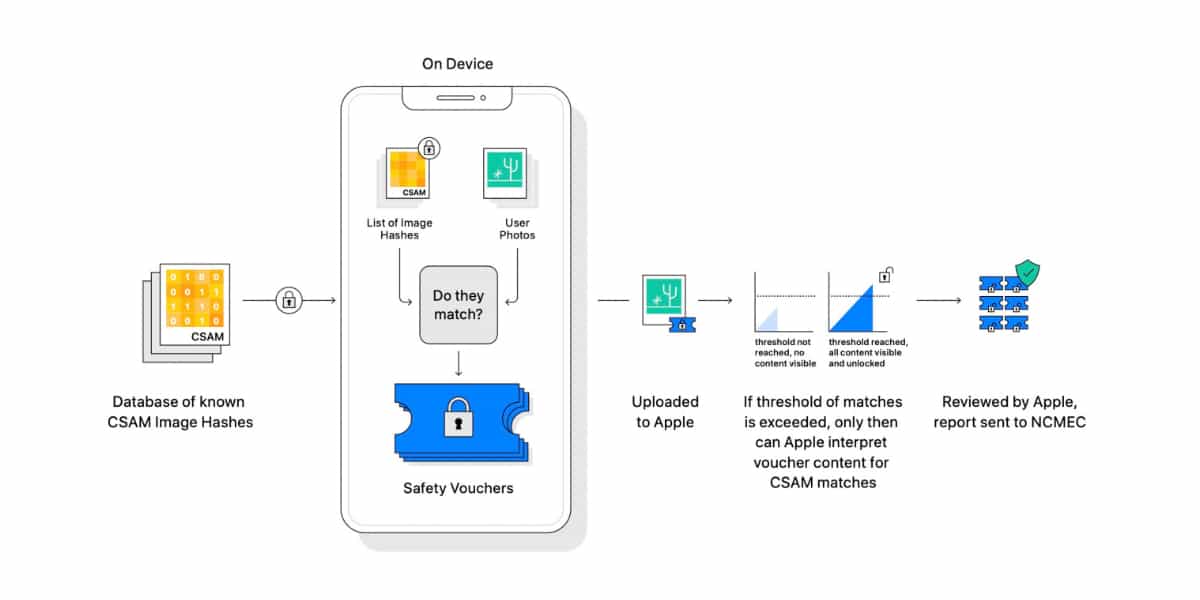

Este plano queria usar um sistema combinado primeiro automático e, em seguida, manual, chamado neuralMatch para descobrir imagens suspeitas de abuso infantil nas bibliotecas de fotos privadas dos usuários que as mantêm no iCloud.

O sistema pretendia fazer uma varredura digital automática de todas as fotos que um usuário salva em sua conta do iCloud. Se o software do servidor detectasse uma possível fotografia "suspeita" contendo pornografia infantil, alertaria uma equipe de revisores humanos para eles verificarem.

Se o referido revisor viu possível abuso infantil na imagem, a Apple Eu comunicaria às autoridades locais relevante. As intenções da empresa eram obviamente boas, mas a empresa Privacidade Das pessoas.

Pouco depois de a Apple anunciar seu plano de CSAM, ela enfrentou uma enxurrada de críticas de grupos de privacidade, grupos de direitos e organizações de privacidade. Direito à privacidade. Até mesmo alguns grupos de funcionários da empresa aderiram à reação negativa ao projeto de sua empresa.

Projeto interrompido, não descartado

Agora maçã apagou de sua página Segurança para crianças de seu site oficial qualquer indicação do projeto CSAM, planejado para ser lançado em uma versão futura do iOS 15. De acordo com recém publicado The VergeA Apple não abandonou o projeto CSAM, mas quer ver como pode modificá-lo para que seja aceito por todos os opositores. Difícil tem.