Per poder competir amb els seus rivals, Apple ha començat a apostar més per la intel·ligència artificial. Google o Facebook no tenen problemes a l'recollir dades dels usuaris i reconèixer que ho fan per millorar els seus sistemes d'intel·ligència artificial i aprenentatge automàtic (Machine Learning), però Apple no pensa el mateix; als de Cupertino sí que els preocupa la nostra privacitat. Per aquesta raó, en la passada WWDC ens van parlar de Privacitat diferencial, El seu sistema per recollir dades, millorar la seva AI i, a el mateix temps, protegir la nostra privacitat.

La resta de companyies volen saber constantment coses com on som, què comprem o com fem servir el teclat, el que inclou el que busquem, però no sembla que això li hagi preocupat mai a Apple, una companyia que, en teoria, no té res a fer amb les dades dels seus clients: no venen publicitat, només els seus productes. Tim Cook i companyia ofereixen dispositius segurs perquè els usuaris també ens sentim segurs, i això és una cosa que Apple no vol canviar.

Differential Privacy estudia el general, protegeix l'individu

Com ja van dir alguns especialistes en Aprenentatge automàtic i AI, el problema per a Apple és que, si no fa alguna cosa, es quedarà anys llum per darrere de la competència pel que fa a assistents virtuals. Aquí és on entre en joc el Differential Privacy de què ens van parlar en la passada WWDC. Craig Federighi ho explicava així:

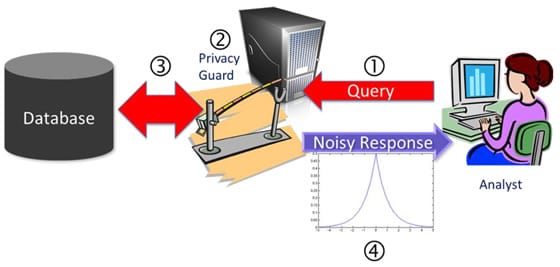

Differential Privacy és un tema de recerca en l'àrea d'estadístiques i anàlisi de dades que fa servir algoritmes hash, mostreig secundari i injecció de soroll per permetre aquest tipus d'aprenentatge de moltes fonts mentre es manté la informació de cada usuari totalment privada.

Privacitat diferencial no és un invent d'Apple. Els acadèmics han estudiat el concepte durant anys però, amb el llançament de iOS 10, Apple començarà a utilitzar aquest concepte per recollir i analitzar dades d'usuaris de el teclat, Spotlight i Notes.

Differential Privacy funciona mitjançant la codificació d'algoritmes de dades d'individus, De manera que no es pugui controlar a la persona un cop s'hagin analitzat les dades de milers d'usuaris per recollir patrons de tendències a gran escala. L'objectiu és protegir la identitat de l'usuari i els detalls de les seves dades a el mateix temps que s'aconsegueix informació general que ajudarà a millorar l'aprenentatge automàtic

iOS 10 barrejarà aleatòriament les nostres dades dins del nostre dispositiu abans de enviar-en massa a Apple, per la qual cosa les dades mai s'enviaran de manera insegura. D'altra banda, Apple tampoc emmagatzemarà cada paraula que escrivim amb el teclat o les cerques que realitzem perquè, com he esmentat anteriorment, no ho necessita. Els de Cupertino diuen que limitaran la quantitat de dades que poden recollir de cada usuari.

Apple va oferir els documents de la seva implementació de Differential Privacy a professor Aaron Roth de la Universitat de Pennsylvania i el professor, qui es podria dir que ha escrit la Bíblia sobre la privacitat diferencial (Fundacions algorítmiques de privacitat diferencial), i va descriure el treball d'Apple en aquest terreny com «pioner» o «innovador».

Com funciona Differential Privacy

Differential Privacy no és una tecnologia única. És una aproximació a l'processat de dades que crea restriccions per evitar que les dades es relacionin amb usuaris concrets. Permet que les dades siguin analitzats en conjunt, però afegeix cert soroll a les dades, el que fa que la privacitat individual no pateixi a el mateix temps que les dades són processades en massa. Adam Smith el defineix de la següent manera:

Tècnicament és una definició matemàtica. Simplement restringeix les diferents maneres en què es poden processar els dades. I els restringeix d'una manera que no permet que es vinculi massa informació sobre cap punt d'extracció d'interval individual en el grup de dades.

D'altra banda, compara Differential Privacy amb ser capaç de seleccionar una melodia subjacent darrere d'una capa de soroll estàtic d'una ràdio mal sintonitzada:

Un cop entens el que estàs escoltant, és realment fàcil ignorar l'estàtica. Així que és una mica com el que passa amb cada individu, no aprens gaire d'un sol individu, però en conjunt es poden veure els patrons bastant clars.

Smith creu que Apple és la primera companyia important que intenta usar Differential Privacy a gran escala. Altres companyies com AT & T han realitzat estudis, però encara no s'han atrevit a usar-lo.

I el futur de la Intel·ligència Artificial?

El debat de la privacitat de Sillicon Valley sol veure a través de les forces de la llei, que posa en una balança la privacitat i la seguretat nacional. Per a les companyies, el debat està entre la privacitat i les funcions. El que ha començat Apple podria canviar el debat radicalment.

Google i Facebook, entre d'altres, han intentat resoldre la qüestió de com oferir grans productes amb moltes funcions que a el mateix temps siguin privats. Ni Allo, l'aplicació de missatgeria més nova de Google, ni Facebook Messenger ofereixen xifrat d'extrem-a-extrem per defecte perquè totes dues companyies necessiten les dades dels usuaris per millorar el seu aprenentatge automàtic i permetre que funcionin els seus brossa. Apple també vol recollir dades dels usuaris, però no per això eliminarà el xifrat d'extrem-a-extrem d'iMessage. Smith diu que la implementació d'Apple podria fer que la resta de companyies canviessin la seva manera de pensar.

En definitiva, sembla que Apple s'ha atrevit a usar un sistema de què ja existien teories que recollirà dades de molta gent sense violar la nostra privacitat. Li copiarà algú en això?