For at konkurrere med sine rivaler er Apple begyndt at satse mere på kunstig intelligens. Google eller Facebook har ikke noget problem med at indsamle brugerdata og erkende, at de gør det for at forbedre deres kunstige intelligens- og maskinlæringssystemer (Machine Learning), men Apple synes ikke det samme; Cupertinos er ligeglad med vores privatliv. Af den grund fortalte de os om det i sidste WWDC Differentiel privatliv, dit system til at indsamle data, forbedre din AI og samtidig beskytte vores privatliv

Resten af virksomhederne vil konstant vide ting som hvor vi er, hvad vi køber, eller hvordan vi bruger tastaturet, som inkluderer det, vi leder efter, men det ser ikke ud til, at dette nogensinde har bekymret Apple, et firma, der i teori, har intet at gøre. gøre med dine kunders data: de sælger ikke reklame, kun deres produkter. Tim Cook og firma tilbyde sikre enheder så brugerne også føler sig trygge, og det er noget, som Apple ikke ønsker at ændre.

Differential Privacy studerer det generelle, beskytter individet

Som nogle specialister i Maskinelæring Og AI, problemet for Apple er, at hvis det ikke gør noget, vil det være lysår bag konkurrencen, når det kommer til virtuelle assistenter. Det er her, Differential Privacy, som vi tidligere blev fortalt om, spiller ind WWDC. Craig Federighi forklarede det sådan:

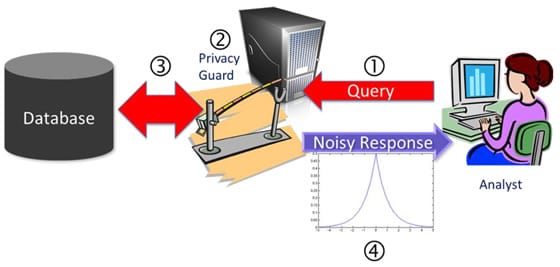

Differential Privacy er et forskningsemne inden for statistik og dataanalyse, der bruger hashing-algoritmer, undersampling og støjinjektion for at tillade denne type læring fra mange kilder, samtidig med at hver brugers information holdes helt privat.

Differentiel privatliv ikke en æbleopfindelse. Forskere har studeret konceptet i årevis, men med udgivelsen af iOS 10 begynder Apple at bruge dette koncept til at indsamle og analysere data fra brugere af tastatur, Spotlight og Notes.

Differential Privacy fungerer efter algoritmekodning af individuelle data, så personen ikke kan kontrolleres, når dataene fra tusinder af brugere er blevet analyseret for at indsamle store trendmønstre. Målet er at beskytte brugerens identitet og detaljerne i deres data, samtidig med at man får generel information, der hjælper med at forbedre maskinindlæring

iOS 10 Det vil tilfældigt blande vores data inden for vores enhed, før de sendes til Apple, så dataene sendes aldrig usikkert. På den anden side gemmer Apple ikke hvert ord, vi skriver med tastaturet eller de søgninger, vi udfører, fordi det, som jeg nævnte ovenfor, ikke har brug for det. De i Cupertino siger, at de vil begrænse mængden af data, de kan indsamle fra hver bruger.

Apple tilbød dokumenterne om implementeringen af Differential Privacy til professoren Aaron Roth fra University of Pennsylvania og professoren, der uden tvivl har skrevet Bibelen om Differential Privacy (Algorithmic Foundations of Differential Privacy), og beskrevet Apples arbejde på dette område som "banebrydende" eller "banebrydende."

Sådan fungerer differentieret privatliv

Differentiel privatliv er ikke en unik teknologi. Det er en tilgang til databehandling oprette begrænsninger for at forhindre, at data relateres til brugerne beton. Det gør det muligt at analysere dataene som en helhed, men tilføjer noget støj til dataene, hvilket betyder, at privatlivets fred ikke lider samtidig med, at dataene behandles massevis. Adam Smith definerer det som følger:

Teknisk er det en matematisk definition. Det begrænser bare de forskellige måder, data kan behandles på. Og det begrænser dem på en måde, der ikke tillader, at der linkes for meget information om ethvert individuelt intervaludvindingspunkt i datagruppen.

På den anden side sammenligner han Differential Privacy med at være i stand til at vælge en underliggende melodi bag et lag med statisk støj fra en dårligt tunet radio:

Når du først har forstået, hvad du hører, er det virkelig nemt at ignorere statisk. Så det er lidt som hvad der sker med hver enkelt, du lærer ikke for meget af et individ, men generelt kan du se mønstrene ret klare.

Det mener Smith Apple er det første store firma, der prøver at bruge Differential Privacy i stor skala. Andre virksomheder som AT&T har gennemført undersøgelser, men har ikke vovet at bruge det endnu.

Og fremtiden for kunstig intelligens?

Diskussionen om fortrolighed i Silicon Valley ses ofte gennem retshåndhævelse, som vejer privatlivets fred og national sikkerhed. For virksomheder er debat er mellem privatlivets fred og funktioner. Hvad Apple har startet, kunne ændre debatten radikalt.

Google og Facebook har blandt andet forsøgt at løse spørgsmålet om, hvordan man kan tilbyde gode produkter med mange funktioner, der på samme tid forbliver private. Hverken Allo, Googles nyeste messaging-app eller Facebook Messenger tilbyder end-til-end-kryptering som standard, fordi begge virksomheder har brug for brugerdata for at forbedre deres maskinindlæring og gøre det muligt for deres bots at fungere. Apple ønsker også at indsamle brugerdata, men fjerner ikke iMessage end-to-end-kryptering. Smith siger, at Apples implementering kan få andre virksomheder til at skifte mening.

Kort sagt ser det ud til, at Apple har vovet at bruge et system, der allerede eksisterede teorier, der vil indsamle data fra mange mennesker uden at krænke vores privatliv. Vil nogen kopiere dig på dette?