Afin de rivaliser avec ses rivaux, Apple a commencé à miser davantage sur l'intelligence artificielle. Google ou Facebook n'ont aucun problème à collecter les données des utilisateurs et à reconnaître qu'ils le font pour améliorer leurs systèmes d'intelligence artificielle et d'apprentissage automatique (Machine Learning), mais Apple ne pense pas la même chose; Cupertinos se soucie de notre vie privée. Pour cette raison, lors de la dernière WWDC, ils nous ont parlé de Confidentialité différentielle, votre système pour collecter des données, améliorer votre IA et en même temps protéger notre vie privée.

Les autres entreprises veulent constamment savoir où nous en sommes, ce que nous achetons ou comment nous utilisons le clavier, ce qui inclut ce que nous recherchons, mais il ne semble pas que cela ait jamais inquiété Apple, une entreprise qui, en la théorie, cela n'a rien à voir avec les données de vos clients: ils ne vendent pas de publicité, seulement leurs produits. Tim Cook et compagnie proposer des appareils sécurisés pour que les utilisateurs se sentent également en sécurité, et c'est quelque chose qu'Apple ne veut pas changer.

La confidentialité différentielle étudie le général, protège l'individu

Comme certains spécialistes de Machine Learning Et AI, le problème pour Apple est que s'il ne fait rien, il aura des années-lumière de retard sur la concurrence en matière d'assistants virtuels. C'est là que la confidentialité différentielle dont on nous a parlé dans le passé entre en jeu. WWDC. Craig Federighi l'a expliqué comme ceci:

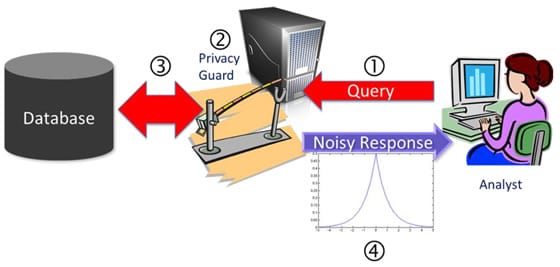

La confidentialité différentielle est un sujet de recherche dans le domaine des statistiques et de l'analyse de données qui utilise des algorithmes de hachage, du sous-échantillonnage et de l'injection de bruit pour permettre ce type d'apprentissage à partir de nombreuses sources tout en gardant les informations de chaque utilisateur complètement privées.

Confidentialité différentielle pas une invention de pomme. Les chercheurs ont étudié le concept pendant des années, mais avec la sortie d'iOS 10, Apple commencera à utiliser ce concept pour collecter et analyser les données des utilisateurs du clavier, de Spotlight et de Notes.

La confidentialité différentielle fonctionne par codage par algorithme de données individuelles, de sorte que la personne ne peut pas être contrôlée une fois que les données de milliers d'utilisateurs ont été analysées pour collecter des modèles de tendance à grande échelle. L'objectif est de protéger l'identité de l'utilisateur et les détails de ses données tout en obtenant des informations générales qui permettront d'améliorer l'apprentissage automatique.

iOS 10 Il mélangera aléatoirement nos données dans notre appareil avant de les envoyer en masse à Apple, de sorte que les données ne seront jamais envoyées de manière non sécurisée. D'autre part, Apple ne stockera pas tous les mots que nous tapons avec le clavier ou les recherches que nous effectuons car, comme je l'ai déjà mentionné, il n'en a pas besoin. Les gens de Cupertino disent qu'ils limiteront la quantité de données qu'ils peuvent collecter auprès de chaque utilisateur.

Apple a offert les documents de sa mise en œuvre de la confidentialité différentielle au professeur Aaron Roth de l'Université de Pennsylvanie et du professeur, qui a sans doute écrit la Bible on Differential Privacy (Algorithmic Foundations of Differential Privacy), et décrit le travail d'Apple dans ce domaine comme «pionnier» ou «révolutionnaire».

Comment fonctionne la confidentialité différentielle

La confidentialité différentielle n'est pas une technologie unique. C'est une approche du traitement des données qui créer des restrictions pour empêcher les données d'être liées aux utilisateurs béton. Il permet d'analyser les données dans leur ensemble, mais ajoute un peu de bruit aux données, ce qui signifie que la vie privée individuelle ne souffre pas en même temps que les données sont traitées en masse. Adam Smith le définit comme suit:

Techniquement, c'est une définition mathématique. Cela restreint simplement les différentes façons dont les données peuvent être traitées. Et cela les restreint d'une manière qui ne permet pas de lier trop d'informations sur un point d'extraction d'intervalle individuel dans le groupe de données.

D'autre part, il compare la confidentialité différentielle à la capacité de sélectionner une mélodie sous-jacente derrière une couche de bruit statique d'une radio mal réglée:

Une fois que vous comprenez ce que vous entendez, il est vraiment facile d'ignorer les parasites. C'est donc un peu comme ce qui se passe avec chaque individu, on n'apprend pas trop d'un seul individu, mais dans l'ensemble, on peut voir les schémas assez clairement.

Smith croit que Apple est la première grande entreprise à essayer d'utiliser la confidentialité différentielle sur une grande Scale. D'autres sociétés comme AT&T ont mené des études, mais n'ont pas encore osé l'utiliser.

Et l'avenir de l'intelligence artificielle?

Le débat sur la confidentialité de la Silicon Valley est souvent envisagé à travers les forces de l'ordre, qui pèsent sur la confidentialité et la sécurité nationale. Pour les entreprises, le le débat se situe entre la confidentialité et les fonctionnalités. Ce qu'Apple a commencé pourrait changer radicalement le débat.

Google et Facebook, entre autres, ont tenté de résoudre la question de savoir comment offrir de bons produits avec de nombreuses fonctionnalités privées en même temps. Ni Allo, la dernière application de messagerie de Google, ni Facebook Messenger n'offrent par défaut un cryptage de bout en bout, car les deux entreprises ont besoin de données utilisateur pour améliorer leur apprentissage automatique et permettre à leurs robots de fonctionner. Apple souhaite également collecter des données utilisateur, mais ne supprimera pas le Cryptage de bout en bout iMessage. Smith affirme que la mise en œuvre d'Apple pourrait amener d'autres entreprises à changer d'avis.

En bref, il semble qu'Apple ait osé utiliser un système qui existait déjà des théories qui collecteront des données de nombreuses personnes sans violer notre vie privée. Quelqu'un vous copiera-t-il là-dessus?