Čini se da je Apple to odlučio zaustaviti CSAM plan revizija koje je planirao provesti na fotografijama svojih korisnika koji traže dječju pornografiju. Na Appleovoj web stranici više nema ni traga kontroverznom planu.

Ne znamo radi li se trenutno o privremenom povlačenju, traženju najboljeg načina za implementaciju sustava ili jednostavno prekida projekt. Činjenica je da je CSAM plan nestao sa stranice o sigurnosti djece službene web stranice Apple.

Već nekoliko mjeseci pričamo o kontroverznom projektu koji je Apple imao na umu, da poveća sigurnost digitalnog sadržaja svojih uređaja. To se zove CSAM plan Apple.

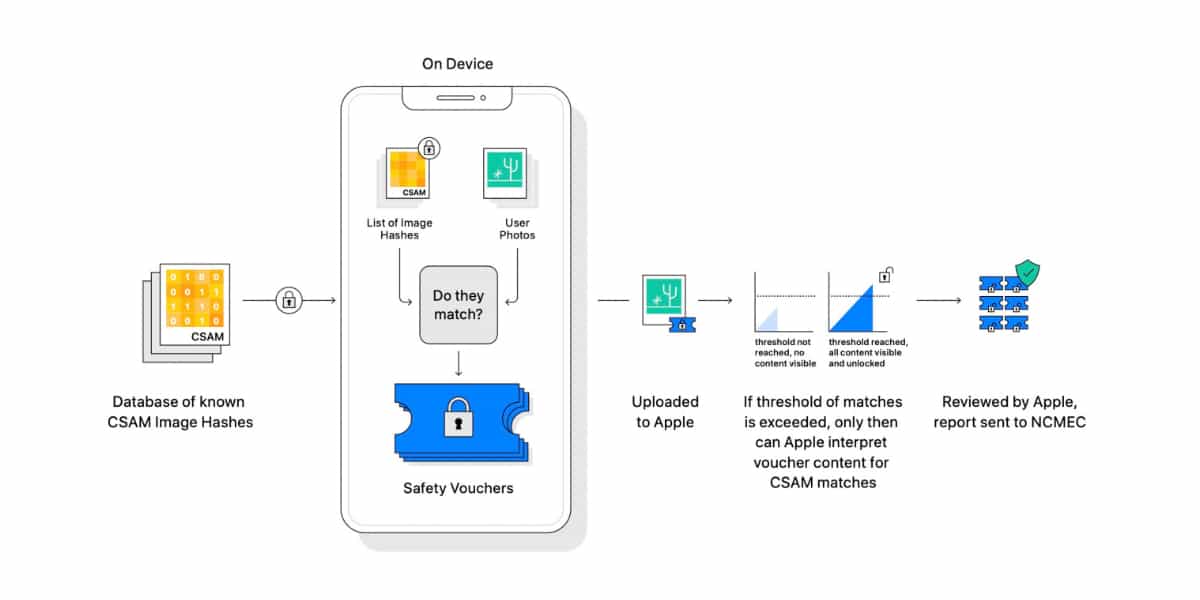

Ovaj plan htio je koristiti kombinirani prvi automatski, a kasnije ručni sustav tzv neuralMatch kako biste otkrili sumnjive slike zlostavljanja djece u privatnim bibliotekama fotografija korisnika koje ih čuvaju u iCloudu.

Sustav je namjeravao izvršiti automatsko digitalno skeniranje svih fotografija koje korisnik sprema na svoj iCloud račun. Ako je poslužiteljski softver otkrio moguću "sumnjivu" fotografiju koja sadrži dječju pornografiju, upozorio je tim ljudski recenzenti da oni provjere.

Ako je recenzent vidio moguće zlostavljanje djece na slici, Apple Ja bih to priopćio lokalnim vlastima relevantan. Namjere tvrtke bile su očito dobre, ali tvrtke Privatnost od ljudi.

Ubrzo nakon što je Apple najavio svoj CSAM plan, suočio se s hrpom kritika od strane skupina za zaštitu privatnosti, skupina za prava i organizacija za zaštitu privatnosti. Pravo na privatnost. Čak su se i neke skupine zaposlenika tvrtke pridružile negativnoj reakciji na projekt svoje tvrtke.

Projekt je zaustavljen, nije odbačen

Sada jabuka je izbrisao sa vaše stranice Sigurnost djece sa svoje službene web stranice sve naznake CSAM projekta, planiranog za pokretanje u budućoj verziji iOS 15. Prema upravo objavljenom RubuApple nije odustao od CSAM projekta, ali želi vidjeti kako ga može modificirati tako da ga prihvate svi ti zagovornici. Teško je.