Sembra che Apple abbia deciso di interrompere la sua Piano CSAM delle revisioni che intendeva attuare delle fotografie dei suoi utenti alla ricerca di materiale pedopornografico. Non c'è più traccia del controverso piano sul sito web di Apple.

Non sappiamo se al momento si tratti di un ritiro temporaneo, cercando il modo migliore per implementare il sistema, o semplicemente abortisce il progetto. Il fatto è che il piano CSAM è scomparso dalla pagina sulla sicurezza dei bambini del Sito ufficiale da Apple.

Si parla ormai da qualche mese del controverso progetto che aveva in mente Apple, per aumentare la sicurezza dei contenuti digitali dei suoi dispositivi. È chiamato Piano CSAM da Apple.

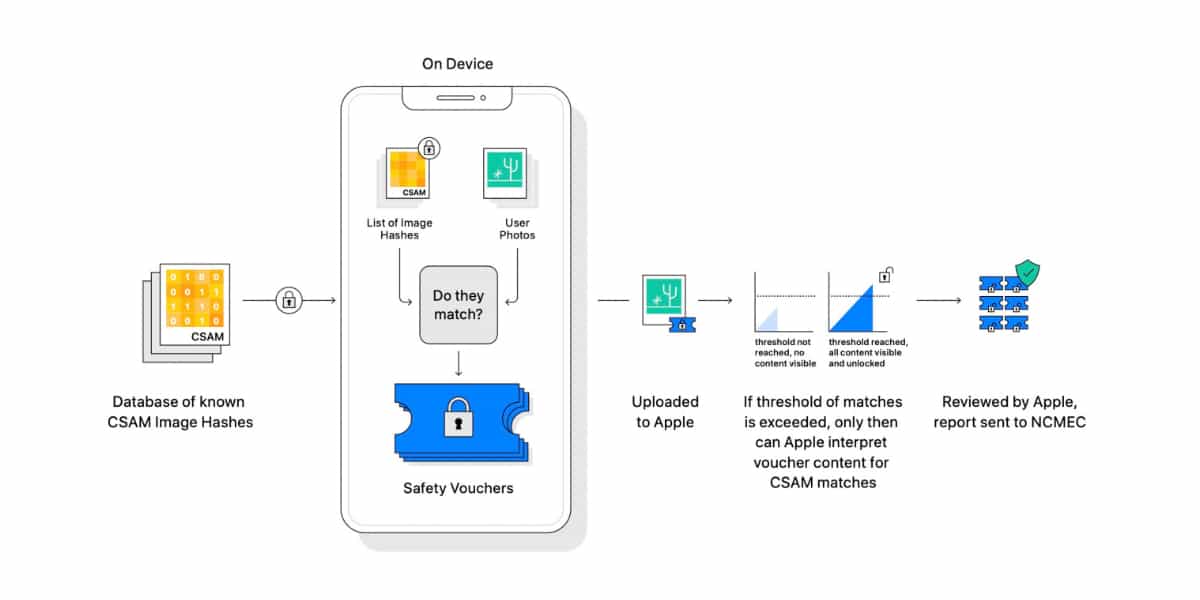

Questo piano voleva utilizzare un sistema combinato prima automatico e poi manuale chiamato neuralMatch per scoprire immagini sospette di abusi sui minori nelle librerie di foto private degli utenti che le conservano in iCloud.

Il sistema intendeva eseguire una scansione digitale automatica di tutte le foto che un utente salva nel proprio account iCloud. Se il software del server ha rilevato una possibile fotografia "sospetta" contenente materiale pedopornografico, ha avvisato un team di revisori umani per loro di controllare.

Se detto revisore ha visto possibili abusi sui minori nell'immagine, Apple Lo comunicherei alle autorità locali pertinente. Le intenzioni dell'azienda erano ovviamente buone, ma quelle dell'azienda privacy delle persone.

Poco dopo che Apple ha annunciato il suo piano CSAM, ha dovuto affrontare una raffica di critiche da parte di gruppi per la privacy, gruppi per i diritti e organizzazioni per la privacy. Diritto alla privacy. Anche alcuni gruppi di dipendenti dell'azienda hanno aderito alla reazione negativa del progetto della loro azienda.

Progetto interrotto, non scartato

Ora mela ha cancellato dalla tua pagina Sicurezza dei bambini dal suo sito ufficiale qualsiasi indicazione del progetto CSAM, previsto per essere lanciato in una futura versione di iOS 15. Secondo appena pubblicato La VergeApple non ha abbandonato il progetto CSAM, ma vuole vedere come può modificarlo in modo che sia accettato da tutti quegli oppositori. Difficile ce l'ha.