Det ser ut til at Apple har bestemt seg for å stoppe det CSAM-plan av revisjonene som den planla å implementere av fotografiene av brukerne på jakt etter barnepornografi. Det er ikke lenger et spor etter den kontroversielle planen på Apples nettside.

Vi vet ikke om det for øyeblikket er en midlertidig tilbaketrekking, på jakt etter den beste måten å implementere systemet på, eller bare avbryter prosjektet. Faktum er at CSAM-planen har forsvunnet fra barnesikkerhetssiden til offisiell nettside Apple.

Vi har snakket i noen måneder nå om det kontroversielle prosjektet som Apple hadde i tankene, for å øke sikkerheten til det digitale innholdet på enhetene sine. Det kalles CSAM-plan Apple.

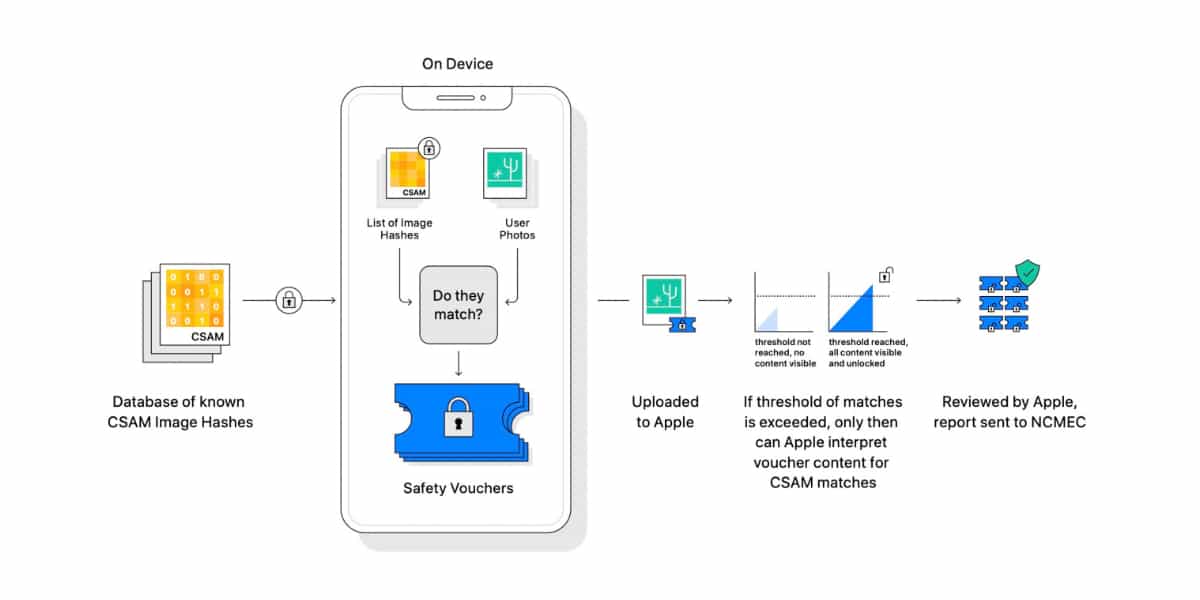

Denne planen ønsket å bruke et kombinert først automatisk og deretter manuelt system kalt neuralMatch for å oppdage mistenkelige bilder av overgrep mot barn i brukernes private bildebiblioteker som oppbevarer dem i iCloud.

Systemet hadde til hensikt å gjøre en automatisk digital skanning av alle bildene som en bruker lagrer på iCloud-kontoen sin. Hvis serverprogramvaren oppdaget et mulig "mistenkelig" fotografi som inneholder barnepornografi, varslet den et team av menneskelige anmeldere for dem å sjekke.

Hvis nevnte anmelder så mulig barnemishandling i bildet, Apple Jeg vil formidle det til de lokale myndighetene relevant. Selskapets intensjoner var selvsagt gode, men selskapets Personvern av folk.

Kort tid etter at Apple kunngjorde sin CSAM-plan, møtte den en bølge av kritikk fra personverngrupper, rettighetsgrupper og personvernorganisasjoner. Rett til privatliv. Til og med noen grupper av bedriftsansatte ble med på den negative reaksjonen på bedriftens prosjekt.

Prosjektet stoppet, ikke forkastet

Nå eple har slettet fra siden din Barnesikkerhet fra den offisielle nettsiden enhver indikasjon på CSAM-prosjektet, planlagt lansert i en fremtidig versjon av iOS 15. I følge nettopp publisert RandenApple har ikke forlatt CSAM-prosjektet, men ønsker å se hvordan det kan endre det slik at det blir akseptert av alle de som ikke sier. Vanskelig har det.