ดูเหมือนว่า Apple ได้ตัดสินใจที่จะหยุดมัน แผน CSAM ของการแก้ไขที่วางแผนจะใช้รูปถ่ายของผู้ใช้ที่กำลังมองหาภาพอนาจารเด็ก ไม่มีร่องรอยของแผนการโต้เถียงบนเว็บไซต์ของ Apple อีกต่อไป

เราไม่ทราบว่าในขณะนี้เป็นการถอนชั่วคราวหรือไม่ กำลังมองหาวิธีที่ดีที่สุดในการนำระบบไปใช้ หรือเพียงแค่ยกเลิกโครงการ ความจริงก็คือแผน CSAM หายไปจากหน้าความปลอดภัยของเด็กของ เว็บไซต์ทางการ ของ Apple

เราได้พูดคุยกันมาแล้วสองสามเดือนเกี่ยวกับโครงการที่มีการโต้เถียงกันซึ่ง Apple คิดไว้ในใจ เพื่อเพิ่มความปลอดภัยให้กับเนื้อหาดิจิทัลในอุปกรณ์ของตน มันถูกเรียกว่า แผน CSAM ของ Apple

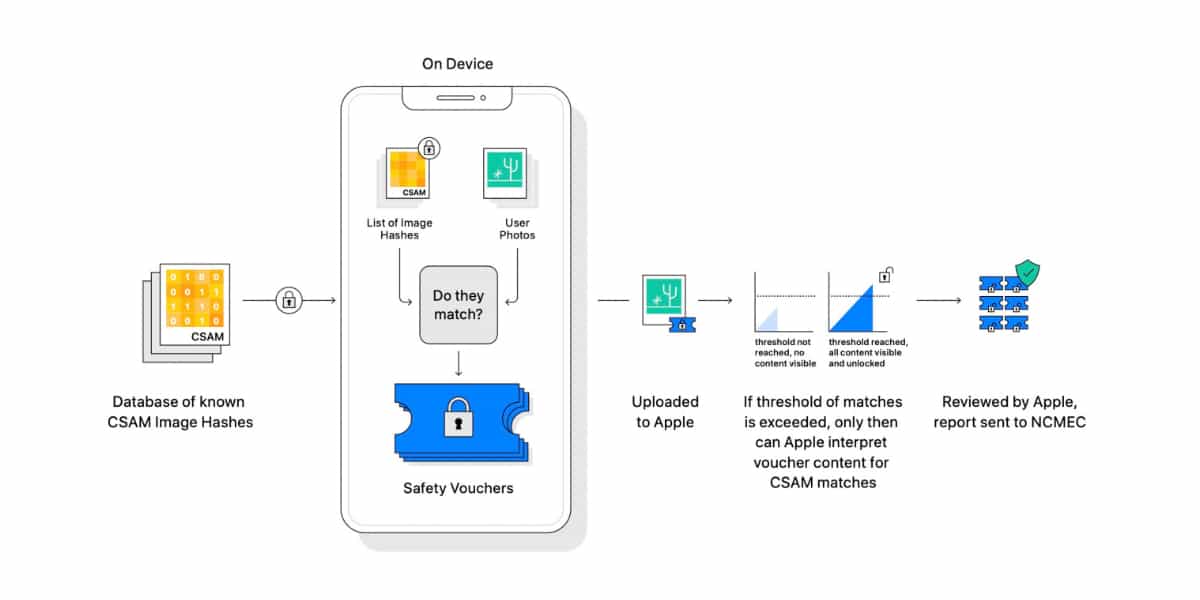

แผนนี้ต้องการใช้ระบบอัตโนมัติระบบแรกและแบบแมนนวลที่เรียกว่า ประสาทMatch เพื่อค้นพบภาพการล่วงละเมิดเด็กที่น่าสงสัยในไลบรารีรูปภาพส่วนตัวของผู้ใช้ที่เก็บไว้ใน iCloud

ระบบนี้มีจุดประสงค์เพื่อทำการสแกนรูปภาพทั้งหมดที่ผู้ใช้บันทึกไว้ในบัญชี iCloud แบบดิจิทัลโดยอัตโนมัติ หากซอฟต์แวร์เซิร์ฟเวอร์ตรวจพบภาพถ่ายที่ "น่าสงสัย" ว่ามีภาพอนาจารเด็ก ซอฟต์แวร์ดังกล่าวจะแจ้งเตือนทีมงานของ นักวิจารณ์ เพื่อให้พวกเขาตรวจสอบ

หากผู้ตรวจสอบดังกล่าวเห็นการล่วงละเมิดเด็กที่อาจเกิดขึ้นในภาพ Apple ฉันจะแจ้งไปยังหน่วยงานท้องถิ่น ที่เกี่ยวข้อง. ความตั้งใจของบริษัทนั้นดีอย่างเห็นได้ชัด แต่บริษัท ความเป็นส่วนตัว ของคน

ไม่นานหลังจากที่ Apple ประกาศแผน CSAM ของตน ก็ต้องเผชิญกับการวิพากษ์วิจารณ์จากกลุ่มความเป็นส่วนตัว กลุ่มสิทธิ และองค์กรความเป็นส่วนตัว สิทธิในความเป็นส่วนตัว. แม้แต่พนักงานของบริษัทบางกลุ่มก็เข้าร่วมในปฏิกิริยาเชิงลบของโครงการของบริษัท

โครงการหยุดไม่ทิ้ง

ตอนนี้ apple ได้ลบ จากเพจของคุณ ความปลอดภัยของเด็ก จากเว็บไซต์อย่างเป็นทางการบ่งชี้ใด ๆ ของโครงการ CSAM วางแผนที่จะเปิดตัวในเวอร์ชันอนาคตของ iOS 15. ตามที่เพิ่งเผยแพร่ VergeApple ไม่ได้ละทิ้งโครงการ CSAM แต่ต้องการดูว่าสามารถปรับเปลี่ยนได้อย่างไรเพื่อให้เป็นที่ยอมรับของผู้ที่ไม่ยอมรับทั้งหมด ลำบากก็มี