在 WWDC 上,增強現實一直備受蘋果公司的關注。 然而,這種非典型的呈現方式似乎是一系列令人眼花繚亂的新奇事物,這意味著來自庫比蒂諾的人不會太關注 ARKit,您的增強現實開發套件。 從昨天起,新的開發者就可以使用了 ARKit 4 具有三個偉大的新奇之處:利用 LiDAR 掃描儀的深度 API、定位某些位置的虛擬現實的位置錨點或位置錨點,以及最後,與 ARKit 3 相關的改進的面部跟踪支持,利用眾所周知的 蘋果神經引擎.

深度 API,激光雷達掃描儀的未來

El 11 年推出的 iPad Pro 12,9 英寸和 iPad Pro 2020 英寸 他們帶著熟人 LiDAR掃描儀。 該技術允許某些設備通過發射光脈衝來測量距離。 通過這種方式,iPad 能夠處理並創建根據掃描儀發出的不同光脈衝返回所需時間產生的點雲。 這項技術連同 A12Z芯片和另外兩個攝像頭 後方復合體的研究對於理解 新的深度API 包含在 ARKit 4 中。

當與場景幾何生成的 3D 網格數據相結合時,這種深度信息可以實現虛擬對象的即時放置並將其與物理環境無縫混合,從而使虛擬對象遮擋變得更加真實。 這可以在您的應用程序中推動新功能,例如進行更精確的測量並將效果應用於用戶環境。

深度 API 集成支持使用 LiDAR 技術檢測周圍空間。 這將允許開發人員圍繞特定空間甚至 整合 不同的元素具有不同的深度, 對於近幾個月開發的新增強現實模型至關重要。

ARKit 4 中的位置錨點

為了理解這種新穎性,讓我們舉個例子。 我們在巴黎埃菲爾鐵塔前拿出手機。 我們打開一個應用程序,它會自動檢測該位置的增強現實體驗。 當我們啟動它時 數據出現時伴隨著對海拔高度、每層樓的好奇心 和其他信息。 當我們指向另一個不是著名建築的地方時,信息就會停止出現。

這就是蘋果所說的 位置錨或位置錨。 這是一種方式 將精確位置與給定的增強現實體驗錨定或關聯起來。 例如,這將使您能夠利用該工具來生動地呈現著名的城市或紀念碑。

該功能已合併到 ARKit 4 中,但為了正確開發其操作,需要一個 iPhone XS、XS Max、XR 或更高版本。 蘋果還限制了這部分套件的實驗 世界地理選定的城市。

改進的面部跟踪支持

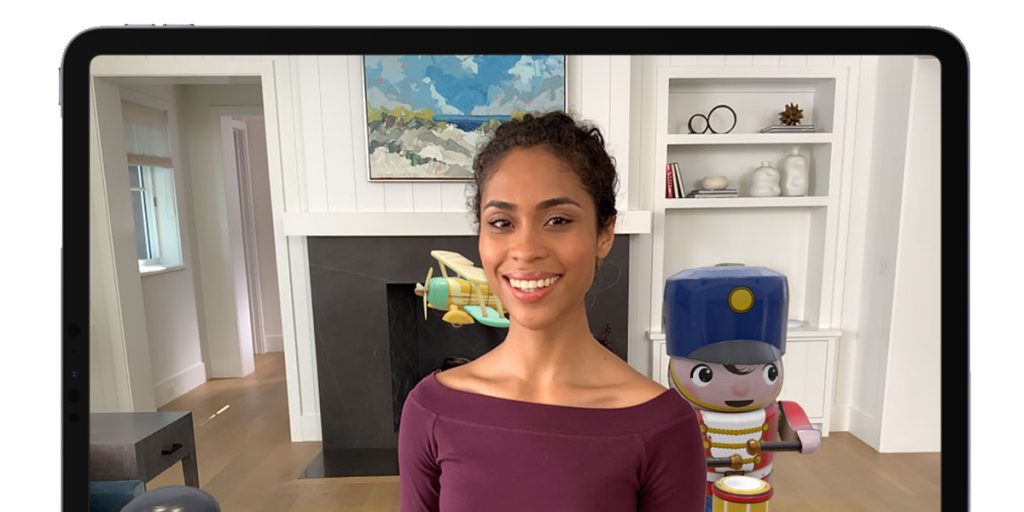

ARKit 3 可以輕鬆將跟踪集成到後置攝像頭中。 在此開發套件的第四個版本中,蘋果帶來了面部追踪 到任何配備 A12 Bionic 芯片或更高版本的設備上的前置攝像頭:

- iPhone XS、XS Max、XR 或更高版本(包括新 SE)

- iPad Air 3 及更高版本(包括 iPad Pro)

- iPad的迷你5

這個新工具 允許您同時跟踪最多 3 個面孔。 據蘋果公司稱,這將增強 Snapchat 或紐約 Memojis 等應用程序中前置攝像頭的體驗。