Jednou z obsesií spoločnosti Apple je zabezpečenia jeho užívateľov. Všetci vieme, ako veľmi sa spoločnosť stará o súkromie svojich zákazníkov, čo je pre Apple niečo posvätné. Aj keď to musí urobiť, musí sa postaviť americkej vláde, dokonca aj CIA. „Ich údaje sa nedotýkajú“ je ich motto.

A teraz sa zamerala na bezpečnosť svojich neplnoletých používateľov. Bude to stačiť «Veľký brat»Monitorovanie obrázkov, ktoré prechádzajú jeho servermi, pri odosielaní správ aj fotografií uložených v službe iCloud, s cieľom odhaliť fotografie, ktoré obsahujú materiál o sexuálnom zneužívaní detí. Bravo.

Tí z Cupertina tento týždeň oznámili sériu opatrení, ktoré zavedú s cieľom chrániť neplnoletých používateľov iPhone, iPad y Mac. Patria sem nové funkcie zabezpečenia komunikácie v Správach, vylepšená detekcia obsahu CSAM (Child Sexual Abuse Material) v iCloud a aktualizované informácie o znalostiach pre Siri a Search.

Myslím, čo si myslíš preskúmajte každú fotografiu používateľov mladších ako 13 rokov, ktorí prechádzajú cez jeho servery, a to buď pri odosielaní alebo prijímaní správ, alebo tých, ktorí sú uložení v službe iCloud, aby zistili tých, ktorí sú podozriví z detského pornografického obsahu. Hneď ako sa podozrivý obrázok automaticky nájde, oznámi, že ho overuje osoba. K dispozícii bude tiež ovládanie vyhľadávania a Siri.

Fotografie priložené k Správam

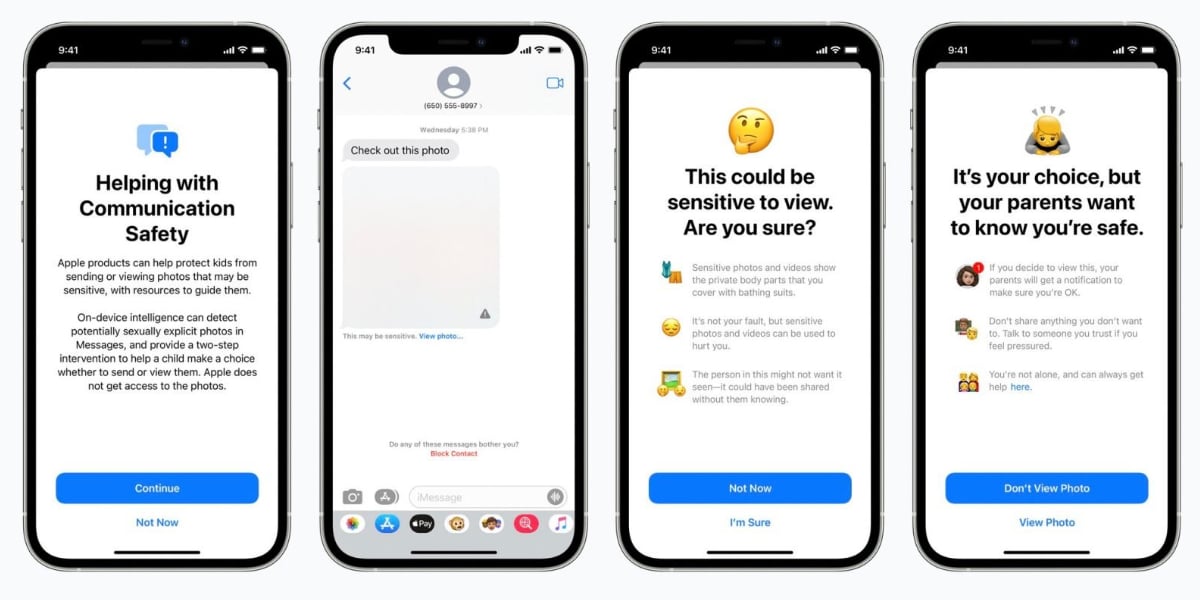

Apple vysvetľuje, že keď mladistvý, ktorý je v a Rodina iCloud dostane alebo sa pokúsi odoslať správu s fotografiami so sexuálnym obsahom, dieťaťu sa zobrazí varovná správa. Obrázok bude rozmazaný a v aplikácii Správy sa zobrazí upozornenie, že obrázok „môže byť citlivý“. Ak sa dieťa dotkne položky „Zobraziť fotografiu“, zobrazí sa mu vyskakovacie okno s informáciou, prečo je obrázok považovaný za citlivý.

Ak maloletý trvá na prezeraní fotografie, jeho otec z iCloud Family dostane a oznámenia „Aby ste sa uistili, že je prezeranie správne.“ Vyskakovacie okno bude obsahovať aj rýchly odkaz na ďalšiu pomoc.

V prípade, že sa dieťa pokúsi odoslať obrázok, ktorý je označený ako sexuálny, zobrazí sa mu podobné varovanie. Apple uvádza, že maloletý bude pred odoslaním fotografie varovaný a že rodičia môžu dostať správu, ak sa dieťa rozhodne ju odoslať. Táto kontrola sa bude vykonávať v účtoch Apple ID, ku ktorým patrí deti do 13 rokov.

Fotografie v iCloude

Takto bude Apple spracovávať fotografie dieťaťa do 13 rokov.

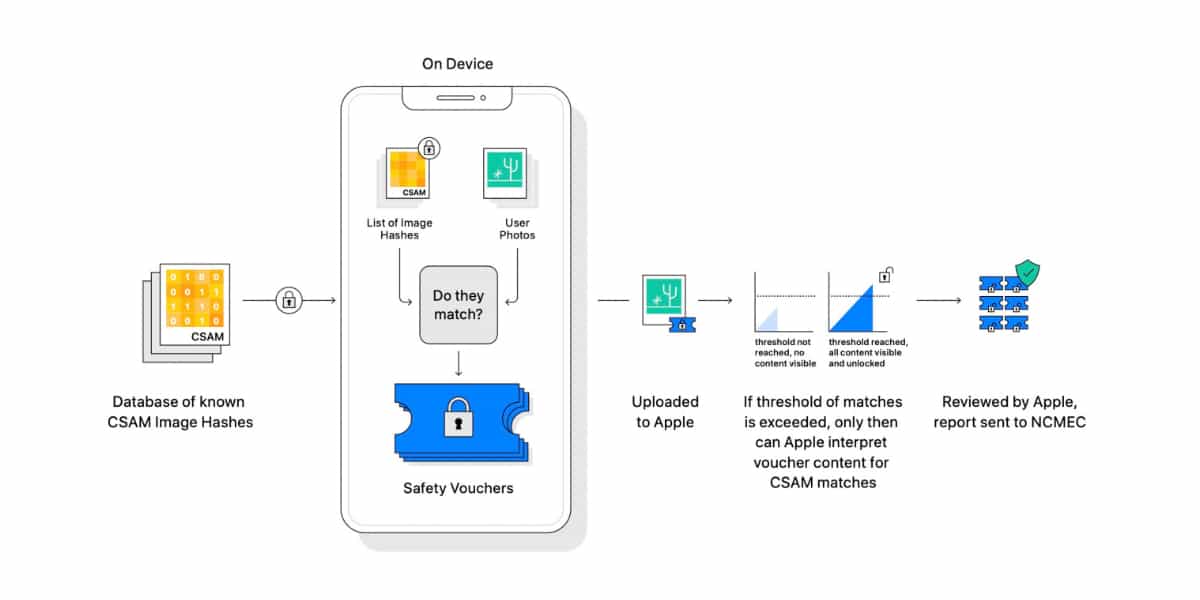

Apple chce detekovať obrázky CSAM (Materiál pre sexuálne zneužívanie detí), ak je uložený vo Fotkách iCloud. Spoločnosť potom bude môcť nahlásiť tip Národnému centru pre nezvestné a zneužívané deti, severoamerickému subjektu, ktorý funguje ako komplexná spravodajská agentúra pre CSAM a úzko spolupracuje s orgánmi činnými v trestnom konaní.

Ak systém nájde možný obrázok CSAM, oznámi, že je overené skutočnou osobou, pred vykonaním akejkoľvek akcie. Po potvrdení spoločnosť Apple deaktivuje používateľský účet a odošle hlásenie Národnému centru USA pre nezvestné a zneužívané deti.

Obrázky, ktoré sú uložené v zariadení a neprechádzajú servermi iCloud, Apple zrejme nemôže ovládať. Celý tento systém kontroly detí najskôr bude implementovaný v USA., a neskôr bude rozšírený do ďalších krajín, počnúc iOS 15, iPadOS 15 a macOS Monterey.

Vyhľadávania a Siri

Siri si bude vedomá vyhľadávaní, ktoré môže používateľ vykonať v súvislosti s Téma CSAM. Tí, ktorí sa napríklad pýtajú Siriho, ako môžu hlásiť CSAM alebo zneužívanie detí, budú presmerovaní na zdroje, kde a ako podať správu, čím sa uľahčí prípadné stíhanie.

Osobnosti ako John Clark, Prezident a generálny riaditeľ Národného centra pre nezvestné a zneužívané deti, Štefana Balkama, zakladateľ a generálny riaditeľ Inštitútu bezpečnosti online pre rodinu, bývalý generálny prokurátor Eric Holder alebo bývalý zástupca generálneho prokurátora George Terwilliger Vyjadrili plnú podporu iniciatíve Apple.