Zdá sa, že Apple sa rozhodol zastaviť svoje plán CSAM revízií, ktoré plánovala vykonať na fotografiách svojich používateľov hľadajúcich detskú pornografiu. Na stránke Applu už po kontroverznom pláne nie je ani stopy.

Nevieme, či momentálne ide o dočasné stiahnutie, hľadanie najlepšieho spôsobu implementácie systému alebo jednoducho prerušíme projekt. Faktom je, že plán CSAM zmizol zo stránky bezpečnosti detí Oficiálne internetové stránky spoločnosti Apple.

Už pár mesiacov hovoríme o kontroverznom projekte, ktorý mal Apple na mysli, na zvýšenie bezpečnosti digitálneho obsahu svojich zariadení. To sa nazýva plán CSAM spoločnosti Apple.

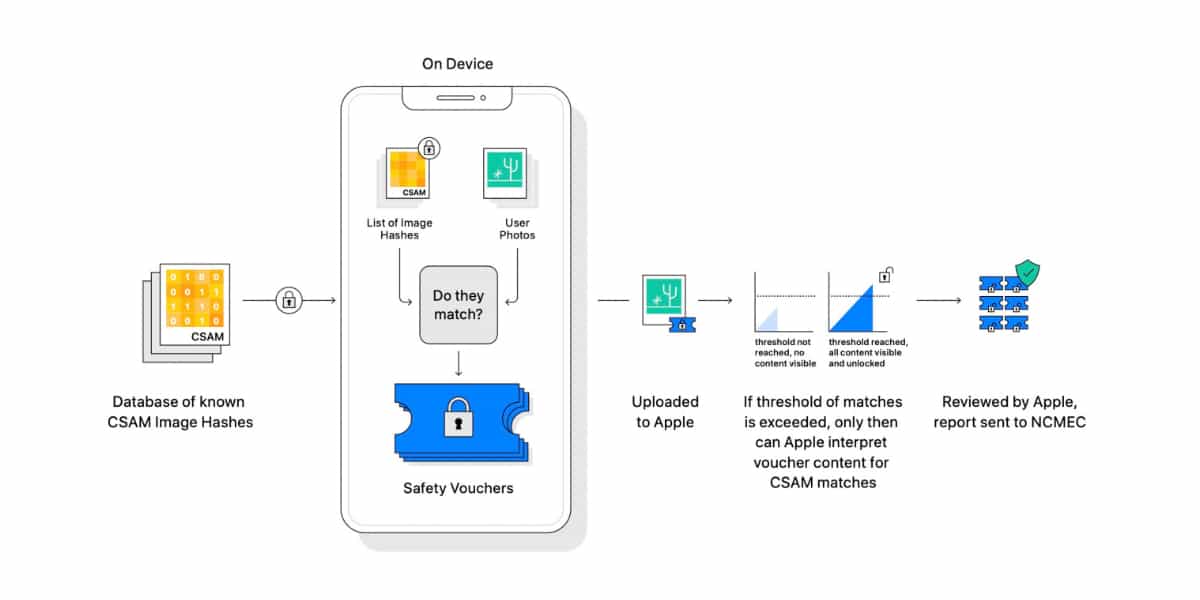

Tento plán chcel využiť kombinovaný najskôr automatický a potom manuálny systém tzv neuralMatch na objavenie podozrivých obrázkov zneužívania detí v súkromných knižniciach fotografií používateľov, ktoré ich uchovávajú v iCloude.

Systém zamýšľal vykonať automatické digitálne skenovanie všetkých fotografií, ktoré si používateľ uloží na svoj iCloud účet. Ak serverový softvér zistil možnú „podozrivú“ fotografiu s detskou pornografiou, upozornil tím z ľudskí recenzenti aby to skontrolovali.

Ak spomínaný recenzent videl na obrázku možné zneužívanie detí, Apple Oznámil by som to miestnym úradom relevantné. Zámery spoločnosti boli zjavne dobré, ale spoločnosti Súkromia z ľudí.

Krátko po tom, čo spoločnosť Apple oznámila svoj plán CSAM, čelila záplave kritiky od skupín na ochranu osobných údajov, skupín na ochranu práv a organizácií na ochranu osobných údajov. Právo na súkromie. K negatívnej reakcii na projekt svojej firmy sa pridali aj niektoré skupiny zamestnancov firmy.

Projekt zastavený, nezaradený

Teraz jablko vymazal z vašej stránky Bezpečnosť detí z jeho oficiálnej webovej stránky akýkoľvek náznak projektu CSAM, ktorého spustenie sa plánuje v budúcej verzii iOS 15. Podľa práve zverejneného VergataApple neopustil projekt CSAM, ale chce vidieť, ako ho môže upraviť tak, aby ho akceptovali všetci tí odporcovia. Je to ťažké.